Mehr Sicherheit im Code: Alte Skripte schrittweise absichern

Der Albtraum am Freitagnachmittag

Kennen Sie dieses beklemmende Gefühl? Es ist Freitag, kurz vor 16 Uhr. Sie sollen "nur mal eben schnell" eine winzige Anpassung an einer zehn Jahre alten JavaScript-Datei vornehmen. Ein Skript, das seit Ewigkeiten unangetastet im Verborgenen schlummert. Sie ändern eine einzige Variable. Plötzlich bricht der gesamte Checkout-Prozess im Online-Shop zusammen. Schweißperlen bilden sich auf Ihrer Stirn. Das Telefon klingelt ununterbrochen. Der Kunde tobt. Genau das ist Fear-Driven Development – die allgegenwärtige Angst davor, dass eine harmlose Änderung das komplette System lahmlegt. Wenn wir diesen fehleranfälligen Legacy Code absichern wollen, liegt die Lösung definitiv nicht in einem blinden Neuschreiben des gesamten Projekts. Stattdessen müssen wir ein starkes, automatisiertes Sicherheitsnetz spannen.

Genau das ist Fear-Driven Development – die allgegenwärtige Angst davor, dass eine harmlose Änderung das komplette System lahmlegt. Warum passiert das? Weil wir uns in einem ungesicherten Terrain bewegen. Alter Code besitzt selten automatisierte Tests. Er wuchert wie Unkraut, unvorhersehbar und tief verwurzelt. Doch wie bändigen wir dieses Chaos? Die Antwort liegt definitiv nicht in einem blinden Neuschreiben des gesamten Projekts. Stattdessen müssen wir ein starkes Sicherheitsnetz spannen.

Der erste Schritt: Den Ist-Zustand einfrieren

Bevor wir auch nur im Entferntesten daran denken, die innere Logik einer verstaubten Funktion zu modernisieren, müssen wir ihr aktuelles Verhalten gnadenlos analysieren. Hier kommen sogenannte "Characterization Tests" ins Spiel.

Stellen Sie sich vor, Sie finden ein extrem zerbrechliches Dinosaurierfossil im Gestein. Sie würden niemals sofort mit einem groben Hammer darauf einschlagen. Sie gießen stattdessen zuerst einen schützenden Gipsabdruck, um die exakte äußere Form für die Ewigkeit festzuhalten. Genau das tun wir mit unserem alten Code. Wir frieren sein Verhalten ein – inklusive aller absurden Bugs, die mittlerweile vielleicht sogar heimlich als "Features" vom System genutzt werden.

Lassen Sie uns das an einem realen Projektbeispiel betrachten. Wir haben eine veraltete Funktion, die Rabatte für einen Webshop berechnet:

1// legacy-discount.js

2function getDiscount(userType, cartTotal) {

3 if (userType === 'VIP' && cartTotal > 100) {

4 return cartTotal * 0.20;

5 } else if (cartTotal > 50) {

6 return cartTotal * 0.10;

7 }

8 return 0;

9}

10module.exports = { getDiscount };Auf den ersten Blick wirkt das erstaunlich simpel. Aber in einem historisch gewachsenen Projekt wird diese Funktion womöglich an fünfzig verschiedenen Stellen mit völlig abstrusen Datentypen aufgerufen. Was passiert, wenn jemand versehentlich null übergibt? Bevor wir den Code refactoren oder mit modernen Werkzeugen wie TypeScript absichern, schreiben wir einen Test, der den aktuellen Zustand unmissverständlich manifestiert.

Das Sicherheitsnetz mit Jest aufbauen

Wir nutzen in diesem Fall das populäre Framework Jest, um unsere Fossil-Abdrücke zu gießen. Wir dokumentieren völlig schonungslos, was das Skript aktuell zurückgibt.

1// legacy-discount.test.js

2const { getDiscount } = require('./legacy-discount');

3

4describe('Characterization Tests für getDiscount', () => {

5 test('sollte 20% Rabatt für VIPs über 100 Euro geben', () => {

6 expect(getDiscount('VIP', 120)).toBe(24);

7 });

8

9 test('sollte 10% Rabatt für normale Nutzer über 50 Euro geben', () => {

10 expect(getDiscount('NORMAL', 60)).toBe(6);

11 });

12

13 test('sollte kurioserweise 0 zurückgeben, wenn cartTotal null ist', () => {

14 // Ein potenzieller Bug im alten Code, den wir vorerst festhalten!

15 expect(getDiscount('VIP', null)).toBe(0);

16 });

17

18 test('sollte 0 zurückgeben, wenn negative Werte übergeben werden', () => {

19 expect(getDiscount('VIP', -50)).toBe(0);

20 });

21});Warum ist dieser Schritt so unglaublich wertvoll? Weil wir jetzt eine sensible Alarmanlage installiert haben. Sobald wir anfangen, den alten Code aufzuräumen oder moderne Sprachfeatures einzubauen, wird uns dieser Test sofort lautstark warnen, wenn wir aus Versehen das Verhalten verändern. Das gibt uns als Entwickler die dringend benötigte Ruhe und das Selbstvertrauen zurück, um produktiv arbeiten zu können.

Darüber hinaus haben wir jetzt eine saubere Ausgangslage geschaffen. Sobald dieses Netz fest gespannt ist, können wir uns um die statische Code-Analyse kümmern, um die verborgenen Tretminen im Skript systematisch aufzuspüren.

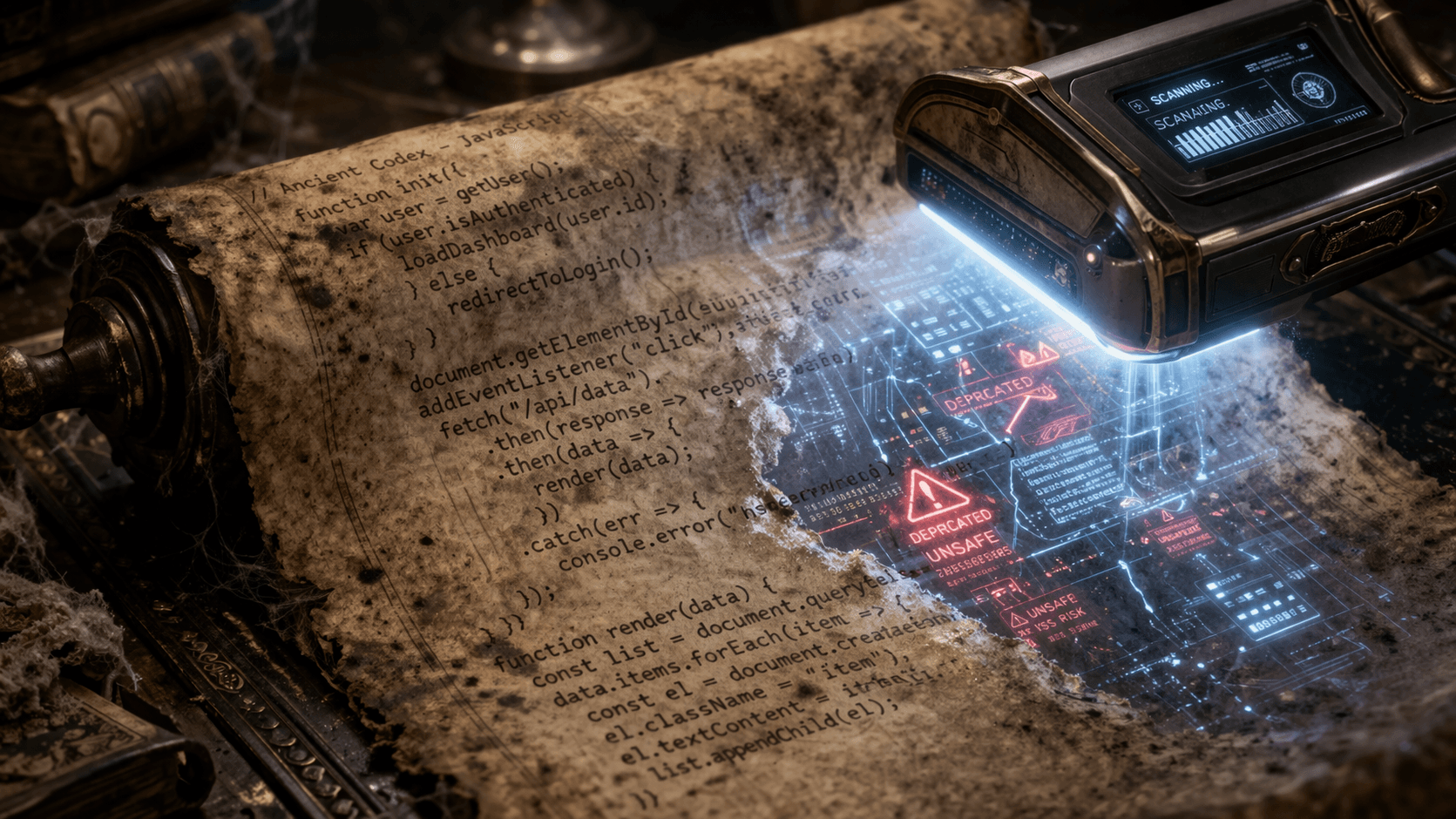

Der Röntgenblick für Ihren Quelltext

Unsere erste Verteidigungslinie steht. Die Characterization Tests leuchten grün und bewachen das äußere Verhalten unserer Anwendung. Doch was verbirgt sich im tiefen, dunklen Inneren der Funktionen? Bevor wir die Architektur aktiv umstrukturieren, um unseren Legacy Code absichern zu können, benötigen wir eine schonende Diagnosemethode. Wir brauchen einen Röntgenblick.

Hier betritt die statische Code-Analyse die Bühne. Ein Linter wie ESLint durchkämmt unseren Text nach toxischen Mustern, ohne das Skript jemals auszuführen. Er findet Variablen, die deklariert, aber nie genutzt wurden, oder warnt vor gefährlichen globalen Zuständen.

Erinnern Sie sich an Ihr letztes Legacy-Projekt? Man integriert enthusiastisch ESLint, tippt erwartungsvoll npm run lint in die Konsole und... der Bildschirm explodiert förmlich in einem Meer aus Rot. "14.532 Probleme gefunden". Verzweiflung macht sich breit. Sollen wir wochenlang alles manuell beheben? Auf keinen Fall! Das wäre wirtschaftlicher Selbstmord und ein massives Risiko.

Wie lösen Profis dieses Dilemma? Sie nutzen einen pragmatischen Trick: Wir frieren auch hier den fehlerhaften Ist-Zustand ein. Werkzeuge wie suppress-eslint-errors fügen automatisch über jedem Regelverstoß einen // eslint-disable-next-line Kommentar ein.

Lassen Sie uns das an einem echten Setup betrachten. Wir integrieren eine strikte, aber faire Grundkonfiguration:

1// eslint.config.js

2module.exports = [

3 {

4 rules: {

5 "no-implicit-globals": "error",

6 "no-undef": "error",

7 "eqeqeq": "warn",

8 "no-unused-vars": "warn"

9 }

10 }

11];Nachdem wir den Suppress-Befehl über unsere alte Datei gejagt haben, sieht das Skript vielleicht so aus:

1// legacy-discount.js

2function getDiscount(userType, cartTotal) {

3 // eslint-disable-next-line eqeqeq

4 if (userType == 'VIP' && cartTotal > 100) {

5 // eslint-disable-next-line no-undef

6 globalDiscountActive = true;

7 return cartTotal * 0.20;

8 }

9 return 0;

10}Ist das perfekt? Nein. Ist es wertvoll? Absolut! Ab sofort ist es unserem Team unmöglich, neue Verstöße dieser Art in die Datei einzubauen, ohne dass die CI/CD-Pipeline sofort Alarm schlägt. Wir haben den Verfall der Code-Qualität rigoros gestoppt. Die bestehenden Sünden können wir nun in kleinen, ungefährlichen Häppchen abarbeiten.

Typensicherheit ohne Kompilierung: Die Magie von JSDoc

Nachdem die offensichtlichen Syntax-Sünden isoliert sind, stoßen wir oft auf das größte Problem in altem JavaScript: mangelndes Kontextwissen. Was genau verbirgt sich hinter dem Parameter userType? Ist es ein String? Ein komplexes Objekt?

Viele Entwickler schreien hier sofort nach TypeScript. Doch eine gigantische Codebasis über Nacht zu migrieren, verschlingt unfassbar viel Zeit und blockiert die Weiterentwicklung neuer Features. Gibt es einen sanfteren Weg, um Legacy Code abzusichern?

Ja, den gibt es. JSDoc bietet uns eine fantastische Brückentechnologie. Indem wir spezielle Kommentare direkt über unsere Funktionen setzen, können wir modernen Editoren (wie VS Code) mitteilen, welche Datentypen wir erwarten. Das geschieht völlig ohne aufwendige Build-Schritte. Wir reichern den Code mit Wissen an, das zuvor nur in den Köpfen längst abgewanderter Entwickler existierte.

Betrachten wir unsere Rabatt-Funktion mit einem frischen JSDoc-Anstrich:

1/**

2 * Berechnet den finalen Rabatt für den Warenkorb.

3 * * @param {'VIP' | 'NORMAL' | 'GUEST'} userType - Die Kundenkategorie.

4 * @param {number} cartTotal - Der aktuelle Warenkorbwert in Euro.

5 * @returns {number} Der berechnete Rabattwert.

6 */

7function getDiscount(userType, cartTotal) {

8 if (userType === 'VIP' && cartTotal > 100) {

9 return cartTotal * 0.20;

10 }

11 // ... restliche Logik

12}Was haben wir damit erreicht? Sobald ein Kollege nun versucht, getDiscount(true, "150") aufzurufen, wird der Editor dies sofort rot unterstreichen und ihn warnen. Wir haben eine starke, schützende Hülle um unsere zerbrechliche Funktion gelegt, ganz ohne die bestehende Architektur zu zerschlagen.

Die unsichtbare Brücke: Der schrittweise Wechsel zu TypeScript

Haben Sie schon einmal versucht, die Reifen eines fahrenden Autos zu wechseln? Genau so fühlt sich ein "Big Bang"-Rewrite eines großen Projekts an. Sie stoppen die gesamte Feature-Entwicklung für Monate, das Management wird nervös, und am Ende haben Sie ein System, das zwar schöner aussieht, aber den Anschluss an den Markt verloren hat. Das ist ein fataler Fehler, den viele Entwicklungsteams leider immer wieder begehen.

Gibt es eine elegantere Lösung, wenn wir im laufenden Betrieb unseren Legacy Code absichern müssen? Absolut. Wir bauen eine unsichtbare Brücke, während der Datenverkehr ganz normal weiterfließt. Anstatt unser gesamtes Projekt über Nacht umzukrempeln, zwingen wir den TypeScript-Compiler dazu, unser verstaubtes JavaScript sanft zu umarmen.

Stellen Sie sich vor, Sie stellen einen hochqualifizierten, aber extrem geduldigen Inspektor an das Ende Ihres Produktionsfließbands. Er prüft die neuen, modernen Bauteile streng, lässt aber die alten Maschinen vorerst weiterlaufen, ohne sofort den Not-Aus-Schalter zu drücken. Genau diesen Zustand erreichen wir mit einer strategisch klugen Konfiguration unserer tsconfig.json.

Werfen wir einen Blick auf eine reale Migrationseinstellung:

1// tsconfig.json - Die sanfte Migration

2{

3 "compilerOptions": {

4 "target": "ES2022",

5 "module": "CommonJS",

6 "allowJs": true,

7 "checkJs": true,

8 "strict": false,

9 "outDir": "./dist",

10 "rootDir": "./src"

11 },

12 "include": ["src/**/*"]

13}Warum ist das Feld allowJs: true hier unser absoluter Lebensretter? Es erlaubt uns, veraltete .js und moderne .ts Dateien vollkommen harmonisch im selben System verschmelzen zu lassen. Sie müssen nicht 120.000 Zeilen Code auf einmal mühsam konvertieren. Sie greifen sich stattdessen nur die exakte Datei, an der Sie heute für ein neues Feature ohnehin arbeiten müssen.

Erinnern Sie sich an Ihr letztes großes Refactoring? Eines dieser Mammutprojekte, das ursprünglich auf vier Wochen geschätzt war und nach sechs Monaten voller Bugs stillschweigend begraben wurde? Genau dieses Trauma vermeiden wir hier. Durch diesen hybriden Ansatz eliminieren wir das finanzielle und technische Risiko beinahe komplett.

Nehmen wir an, wir bauen heute eine neue Zahlungsmethode für unseren in die Jahre gekommenen Shop ein. Wir erstellen dafür eine makellose, streng getypte TypeScript-Datei:

1// modern-payment-processor.ts

2export interface PaymentRequest {

3 amount: number;

4 currency: string;

5 userId: string;

6}

7

8export function processPayment(request: PaymentRequest): boolean {

9 if (request.amount <= 0) {

10 throw new Error("Sicherheitsrisiko: Ungültiger Betrag erkannt!");

11 }

12 // Moderne, sichere Zahlungslogik hier...

13 return true;

14}Jetzt rufen wir diese brandneue, blitzsaubere Funktion aus unserem alten JavaScript-Checkout-Skript auf. Dank unserer Konfiguration versteht unsere Entwicklungsumgebung die Struktur sofort und warnt uns bei falschen Übergabewerten. Wir haben einen extrem sicheren Hafen geschaffen, der sich Tag für Tag, Datei für Datei, Stück für Stück vergrößert. Der Legacy Code wird isoliert und nach und nach ausgetauscht.

Spüren Sie, wie der Druck nachlässt? Sie müssen Ihren Vorgesetzten keine monatelange Pause für ein Refactoring "verkaufen". Sie verbessern die Architektur kontinuierlich während des normalen Tagesgeschäfts.

Doch was passiert, wenn wir diesen reparierten Code nun live schalten wollen? Selbst der sauberste Quelltext nützt wenig, wenn er auf dem Weg zum Produktionsserver beschädigt wird. Wir müssen unser Sicherheitsnetz im nächsten Schritt über unsere Pipeline auswerfen.

Der gnadenlose Wachhund: Automatisierung durch CI/CD

Wir haben nun Tests geschrieben, JSDoc integriert und ESLint konfiguriert. Lokal auf unserem Rechner sieht die Welt wunderbar sicher aus. Doch mal ehrlich: Haben Sie in der Hektik eines anstehenden Releases schon einmal vergessen, die Tests vor dem Commit auszuführen? Natürlich haben Sie das. Wir alle sind nur Menschen. Unter Zeitdruck ignorieren wir gerne blinkende Warnungen im Editor und drücken unsere Änderungen mit Gewalt ins Repository.

Genau hier bricht unser sorgfältig aufgebautes Kartenhaus zusammen. Wenn Sicherheit nur eine optionale Empfehlung für Entwickler bleibt, wird Legacy Code niemals wirklich stabil. Wir benötigen einen unbestechlichen Wächter, der fehlerhaften Code an der Grenze abfängt. Wir müssen unsere Sicherheitsmaßnahmen in die CI/CD-Pipeline verlagern.

Stellen Sie sich diesen Prozess wie die Sicherheitskontrolle am Flughafen vor. Egal, wie oft Sie beteuern, keine gefährlichen Gegenstände im Gepäck zu haben – Ihr Koffer wird trotzdem geröntgt. Ausnahmslos.

Die erste Barriere: Pre-Commit-Hooks mit Husky

Der beste Moment, um einen Fehler abzufangen, ist der Augenblick, bevor er überhaupt im Versionskontrollsystem landet. Hierfür nutzen Profis sogenannte Git Hooks. Ein hervorragendes Werkzeug für JavaScript- und Node-Projekte ist Husky. Es klinkt sich nahtlos in den Git-Workflow ein und blockiert Commits, die unsere Qualitätskriterien verfehlen.

Lassen Sie uns Husky in unser Legacy-Projekt einbauen. Zuerst installieren wir die Bibliothek und das Tool lint-staged, welches dafür sorgt, dass wir nur exakt die Dateien prüfen, die wir auch gerade verändert haben. Niemand möchte zehn Minuten warten, weil bei einem winzigen Fix das gesamte Projekt gelintet wird.

1// package.json (Auszug)

2{

3 "scripts": {

4 "prepare": "husky install",

5 "test": "jest",

6 "lint": "eslint ."

7 },

8 "lint-staged": {

9 "src/**/*.js": [

10 "eslint --fix",

11 "jest --bail --findRelatedTests"

12 ]

13 }

14}Anschließend konfigurieren wir den eigentlichen Hook in der Kommandozeile:

npx husky add .husky/pre-commit "npx lint-staged"Was passiert nun in der Praxis? Ich erinnere mich lebhaft an einen Vorfall im letzten Winter. Ein Junior-Entwickler versuchte freitags um 17 Uhr einen "schnellen Bugfix" für die Preisberechnung hochzuladen. Er hatte versehentlich eine globale Variable überschrieben. Dank Husky ploppte in seinem Terminal sofort eine rote Fehlermeldung auf: Commit abgelehnt. ESLint-Regelverletzung. Ein potenzielles Desaster im Wochenend-Geschäft wurde lautlos und völlig automatisch verhindert.

Die letzte Instanz: Die Pipeline in GitHub Actions

Pre-Commit-Hooks sind großartig, aber sie lassen sich lokal mit dem Befehl --no-verify umgehen. Deshalb spannen wir ein finales, unausweichliches Sicherheitsnetz direkt auf dem Server. Sobald jemand einen Pull Request (PR) erstellt, muss eine automatisierte Pipeline durchlaufen werden.

Wir nutzen hierfür GitHub Actions, da es sich nahtlos in die meisten modernen Repositories integriert. Wir erstellen eine einfache YAML-Konfiguration, die eine saubere Umgebung hochfährt, unsere Abhängigkeiten installiert und unsere Charakterisierungstests sowie den Linter ausführt.

1# .github/workflows/security-gate.yml

2name: Legacy Code Security Gate

3

4on:

5 pull_request:

6 branches: [ main, develop ]

7

8jobs:

9 validate-code:

10 runs-on: ubuntu-latest

11 steps:

12 - name: Checkout Repository

13 uses: actions/checkout@v3

14

15 - name: Setup Node.js

16 uses: actions/setup-node@v3

17 with:

18 node-version: '18.x'

19 cache: 'npm'

20

21 - name: Install Dependencies

22 run: npm ci

23

24 - name: Run ESLint (inkl. Legacy Suppressions)

25 run: npm run lint

26

27 - name: Run Characterization Tests

28 run: npm testDiese wenige Zeilen Code verändern die komplette Dynamik im Team. Code Reviews werden plötzlich entspannter. Niemand muss mehr mühsam nach vergessenen console.log oder fehlerhaften Einrückungen suchen. Die Pipeline markiert den PR mit einem unübersehbaren grünen Haken oder einem dicken roten Kreuz. Wir haben die Angst aus dem Release-Prozess entfernt und durch kalte, verlässliche Maschinenlogik ersetzt.

Doch was ist mit den externen Bibliotheken, die unser altes Projekt nutzt? Oft schlummern gerade in veralteten NPM-Paketen die größten Sicherheitslücken. Darum kümmern wir uns im nächsten Schritt.

Die tickende Zeitbombe im node_modules-Ordner

Wir haben unsere CI/CD-Pipeline abgeriegelt, TypeScript als unsichtbare Brücke etabliert und den eigenen Quelltext durchleuchtet. Fühlen Sie sich jetzt sicher? Das sollten Sie nicht. Denn wir haben bisher einen gewaltigen blinden Fleck ignoriert: fremden Code.

Was nützt Ihnen die dickste, am besten gepanzerte Tresortür an der Vorderseite Ihrer Bank, wenn Sie den Lieferanten an der Hintertür blind vertrauen und deren Pakete unkontrolliert in den Tresorraum stellen? Nichts. In der modernen Webentwicklung besteht eine durchschnittliche Anwendung zu über 80 Prozent aus externen Abhängigkeiten. Wenn wir Legacy Code absichern wollen, müssen wir uns zwingend der dunklen Materie in unserem node_modules-Ordner widmen.

Lassen Sie mich Ihnen eine kurze Geschichte aus dem Entwickler-Alltag erzählen. Letztes Jahr übernahm ich die Rettung eines in die Jahre gekommenen Kundenportals. Die internen Tests leuchteten wunderschön grün. Der Code war sauber strukturiert. Doch ein flüchtiger Blick auf die Abhängigkeiten offenbarte den wahren Albtraum: Eine vier Jahre alte Bibliothek zur PDF-Generierung schleppte 43 kritische Sicherheitslücken mit sich herum. Ein Angreifer hätte durch präparierte Benutzereingaben den gesamten Server kapern können (Remote Code Execution). Der Kunde fiel aus allen Wolken. Sind wir für den Code anderer Leute verantwortlich? Ja, absolut. Denn er läuft auf unseren Servern und verarbeitet die Daten unserer Nutzer.

Der Irrglaube des npm audit fix --force

Wie entschärfen wir diese Bedrohung? Viele Entwickler tippen in ihrer Panik einfach npm audit fix --force in das Terminal. Bitte tun Sie das niemals in einem veralteten System! Dieser Befehl aktualisiert Pakete rücksichtslos über Hauptversionen (Major Updates) hinweg. Das Ergebnis? Ihre Sicherheitslücken sind zwar weg, aber Ihre gesamte Anwendung stürzt beim Start mit kryptischen Fehlermeldungen ab. Wir haben die Sicherheit gegen die Funktionalität eingetauscht. Ein fataler Fehler.

Wir benötigen stattdessen ein kontrolliertes, automatisiertes Überwachungssystem. Ein Werkzeug, das uns winzige, verdauliche Updates serviert, deren Auswirkungen wir sofort durch unsere zuvor geschriebenen Characterization Tests überprüfen können.

Hier kommt Dependabot ins Spiel. Es ist kostenlos in GitHub integriert und agiert wie ein unermüdlicher Lagerist, der jeden Morgen die Haltbarkeitsdaten unserer Pakete prüft. Wir aktivieren ihn mit einer simplen Konfigurationsdatei direkt in unserem Repository:

1# .github/dependabot.yml

2version: 2

3updates:

4 - package-ecosystem: "npm"

5 directory: "/"

6 schedule:

7 interval: "weekly"

8 day: "monday"

9 open-pull-requests-limit: 5

10 ignore:

11 - dependency-name: "legacy-pdf-generator"

12 versions: "> 2.0.0" # Wir blockieren vorerst breaking changesDiese wenige Zeilen Code entfalten eine magische Wirkung. Anstatt jahrelang keine Updates einzuspielen und dann vor einem gigantischen, unlösbaren Update-Berg zu stehen, erhalten wir nun jeden Montagmorgen kleine, isolierte Pull Requests. "Paket X von Version 1.2.0 auf 1.2.1 aktualisieren". Unsere CI/CD-Pipeline startet, die Tests laufen durch. Grün? Dann klicken wir entspannt auf "Merge". Rot? Dann wissen wir exakt, welche einzelne Änderung das System destabilisiert hat.

Software Composition Analysis (SCA) tief in der Pipeline

Doch Dependabot allein reicht nicht aus, wenn es um akute, hochgradig kritische Zero-Day-Exploits geht. Wir müssen den Scan-Prozess für Schwachstellen direkt in unseren Bauprozess (Build Process) integrieren. Werkzeuge wie Snyk oder Trivy durchleuchten den Abhängigkeitsbaum in Echtzeit und stoppen den Release-Vorgang sofort, wenn ein kritisches Risiko erkannt wird.

Binden wir einen solchen Sicherheits-Scan in unsere bestehende GitHub Actions Pipeline ein:

1# Fortsetzung der Pipeline aus dem vorherigen Abschnitt

2 - name: Run Snyk to check for vulnerabilities

3 uses: snyk/actions/node@master

4 env:

5 SNYK_TOKEN: ${{ secrets.SNYK_TOKEN }}

6 with:

7 args: --severity-threshold=critical --fail-on=allMit dem Parameter --severity-threshold=critical definieren wir eine pragmatische rote Linie. Wir zwingen unser Team nicht, jede harmlose Warnung sofort zu beheben – das würde in einem alten Projekt zum kompletten Stillstand führen. Aber wir blockieren rigoros alles, was unser System unmittelbar zerstören könnte.

Durch diese Strategie haben wir den Legacy Code schrittweise von innen und außen gepanzert. Aber wie gehen wir mit der Logik um, die so tief verworren ist, dass selbst modernste Tools verzweifeln? Wie zerschneiden wir den berüchtigten "Spaghetti-Code", ohne dass uns die Soße um die Ohren fliegt?

Die Kunst der Entwirrung: Das Strangler Fig Pattern in der Praxis

Wir haben die Grenzen unseres Systems erfolgreich abgedichtet. Die Pipeline wacht streng über jeden neuen Commit, und externe Pakete werden rigoros gescannt. Aber was passiert, wenn wir den Legacy Code absichern müssen, der den eigentlichen, pulsierenden Kern unseres Unternehmens bildet? Jene tausendzeiligen Monster-Funktionen, die über Jahre hinweg unkontrolliert gewachsen sind? Entwickler nennen dies liebevoll "Spaghetti-Code". Alles hängt untrennbar mit allem zusammen. Wenn Sie an einer einzigen Nudel ziehen, wackelt der gesamte Teller.

Wie entflechten wir dieses Chaos, ohne das System in den Abgrund zu stürzen? Eine bewährte Methode aus der Softwarearchitektur ist das sogenannte "Strangler Fig Pattern" (zu Deutsch: Würgefeigen-Muster). Stellen Sie sich eine exotische Pflanze vor, die im dichten Dschungel vom Himmel herabwächst. Sie umschlingt einen alten, sterbenden Baum, nutzt ihn vorerst als stützendes Gerüst und ersetzt ihn im Laufe der Jahre vollständig. Am Ende bleibt nur noch die neue, starke Struktur der Feige übrig, während der alte Baum lautlos verschwunden ist. Genau dieses faszinierende Naturphänomen übertragen wir nun auf unsere veralteten Skripte.

Betrachten wir ein typisches Schreckensszenario aus dem Programmierer-Alltag. Eine Funktion, die gleichzeitig Daten aus der Datenbank holt, komplexe Steuern berechnet und am Ende noch eine HTML-Rechnung für den Browser generiert.

1// legacy-invoice-processor.js

2async function processAndRenderInvoice(userId, cartItems) {

3 // 1. Datenbeschaffung (API Call direkt in der Logik versteckt)

4 const user = await db.query(`SELECT * FROM users WHERE id = ${userId}`);

5

6 // 2. Komplexe Business-Logik (Steuerberechnung)

7 let total = 0;

8 for (let item of cartItems) {

9 let tax = user.country === 'DE' ? 0.19 : 0.20;

10 total += item.price * (1 + tax);

11 }

12

13 // 3. UI-Rendering (Vermischung von Logik und Darstellung)

14 document.getElementById('invoice-total').innerText = total.toFixed(2);

15 return total;

16}Warum ist dieses Skript ein wahrer Albtraum für jeden Entwickler? Weil es schlichtweg untestbar ist. Wenn Sie hier nur die simple Steuerberechnung überprüfen möchten, müssen Sie zwingend eine Datenbankverbindung aufbauen und gleichzeitig einen Browser-DOM simulieren. Das ist langsam, extrem fehleranfällig und raubt jedem Team die Motivation.

Die Trennung der Zuständigkeiten (Separation of Concerns)

Um diesen Legacy Code abzusichern, wenden wir das Würgefeigen-Prinzip im kleinen Maßstab an. Wir schreiben das Skript auf keinen Fall sofort komplett neu! Stattdessen extrahieren wir lediglich den wertvollsten und fehleranfälligsten Teil – die reine Berechnungslogik – in eine neue, blitzsaubere Funktion. Diesen Vorgang nennt man das Erschaffen von "Pure Functions" (reinen Funktionen). Diese liefern bei exakt gleicher Eingabe immer dieselbe Ausgabe, ohne irgendwelche externen Zustände zu verändern.

1// modern-tax-calculator.js (Neu und sicher isoliert)

2export function calculateTotalWithTax(countryCode, cartItems) {

3 return cartItems.reduce((sum, item) => {

4 const taxRate = countryCode === 'DE' ? 0.19 : 0.20;

5 return sum + (item.price * (1 + taxRate));

6 }, 0);

7}Spüren Sie die Erleichterung? Diese neue Funktion weiß absolut nichts von einer Datenbank. Sie kennt keinen Webbrowser. Sie nimmt lediglich simple Daten entgegen und spuckt ein präzises mathematisches Ergebnis aus. Das macht sie unglaublich leicht testbar. Wir können hunderte automatisierte Tests mit verschiedenen Währungen auf sie abfeuern, und sie laufen in Bruchteilen von Millisekunden fehlerfrei durch.

Im nächsten, entscheidenden Schritt klemmen wir unsere neue, getypte Funktion sanft in das alte Konstrukt ein:

1// legacy-invoice-processor.js (Die Würgefeige übernimmt)

2import { calculateTotalWithTax } from './modern-tax-calculator.js';

3

4async function processAndRenderInvoice(userId, cartItems) {

5 const user = await db.query(`SELECT * FROM users WHERE id = ${userId}`);

6

7 // Alte Logik ersetzt durch den neuen, getesteten Aufruf

8 const total = calculateTotalWithTax(user.country, cartItems);

9

10 document.getElementById('invoice-total').innerText = total.toFixed(2);

11 return total;

12}Wir haben die Eingeweide des alten Skripts ausgetauscht, ohne die äußere Form anzutasten. Das restliche System merkt gar nicht, dass sich im tiefen Inneren etwas Bahnbrechendes verändert hat. Doch wir haben einen massiven Sicherheitsgewinn erzielt. Ein extrem unübersichtlicher Knoten wurde dauerhaft entwirrt.

Dennoch bleibt ein gewaltiges Problem bestehen. Was machen wir mit den direkten Datenzugriffen? Das Aufrufen von Datenbanken tief versteckt im Geschäfts-Code ist ein gigantisches architektonisches Sicherheitsrisiko. Wie isolieren wir diese sensiblen Schnittstellen richtig, um gefährliche Injections und katastrophale Datenlecks zu vermeiden?

Die toxische Zone isolieren: Abhängigkeiten clever kapseln

Wir standen vor einem massiven Problem: Direkte Datenbankaufrufe, die tief im Geschäfts-Code vergraben sind. Wie gehen wir damit um? Stellen Sie sich vor, Sie arbeiten in einem Labor mit hochradioaktivem Material. Sie würden dieses Material niemals mit bloßen Händen durch den Flur tragen. Sie nutzen stattdessen isolierte Handschuhkästen und robotische Greifarme.

Genau diese strikte Trennung benötigen wir, wenn wir hochsensiblen Legacy Code absichern. Die Geschäftslogik darf niemals selbst in die Datenbank greifen. Sie muss die Daten auf einem Silbertablett serviert bekommen. Dieser Ansatz nennt sich in der Fachsprache "Dependency Injection" (Abhängigkeitsinjektion) oder schlicht die Nutzung eines Data Access Layers.

Schauen wir uns an, wie wir unsere Funktion aus dem vorherigen Beispiel endgültig von der Datenbank entkoppeln. Anstatt den db.query Befehl in der Funktion auszuführen, übergeben wir die fertigen Nutzerdaten einfach als Parameter.

1// modern-invoice-handler.js (Der sichere Dirigent)

2import { calculateTotalWithTax } from './modern-tax-calculator.js';

3

4// Die Datenbank-Logik wird in eine eigene, isolierte Datei verbannt

5import { getUserById } from './database/user-repository.js';

6

7export async function processInvoice(userId, cartItems) {

8 try {

9 // 1. Sichere Datenbeschaffung (isoliert)

10 const user = await getUserById(userId);

11

12 if (!user) {

13 throw new Error(`Nutzer mit ID ${userId} nicht gefunden.`);

14 }

15

16 // 2. Reine, sichere Geschäftslogik (Pure Function)

17 const total = calculateTotalWithTax(user.country, cartItems);

18

19 return total;

20 } catch (error) {

21 console.error("Fehler bei der Rechnungsverarbeitung:", error);

22 throw error;

23 }

24}Fällt Ihnen auf, wie elegant dieser Code plötzlich geworden ist? Wir haben einen "Dirigenten" erschaffen. Er orchestriert lediglich das Zusammenspiel zwischen der Datenbank (Schritt 1) und der reinen Mathematik (Schritt 2). Wenn wir diesen Code testen wollen, können wir die Funktion getUserById kinderleicht durch einen Dummy ersetzen (Mocking). Wir haben das Rückgrat unserer Legacy-Anwendung stabilisiert.

Doch eine gewaltige Schwachstelle bleibt bestehen, selbst wenn wir TypeScript nutzen: Die Laufzeit-Realität.

Der eiserne Türsteher: Laufzeit-Validierung mit Zod

Haben Sie schon einmal erlebt, dass ein System komplett abstürzt, weil ein Spaßvogel in einem Eingabefeld ein Emoji statt einer Zahl eingegeben hat? TypeScript ist wunderbar, um Entwickler während des Schreibens von Code zu warnen. Aber sobald das Programm kompiliert ist und auf dem Server läuft, existiert TypeScript nicht mehr. Es ist zu purem JavaScript geworden. Wenn nun eine externe API oder ein manipuliertes Frontend fehlerhafte Daten sendet, kracht unser System unweigerlich zusammen.

Um unseren Legacy Code wirklich abzusichern, benötigen wir einen gnadenlosen Türsteher. Eine Bibliothek, die eingehende Datenstrukturen zur Laufzeit überprüft, bevor sie überhaupt in die Nähe unserer wertvollen Logik gelangen. Der absolute Branchenstandard hierfür ist aktuell Zod.

Zod erlaubt es uns, sogenannte "Schemata" zu definieren. Das sind knallharte Regeln dafür, wie unsere Daten auszusehen haben. Integrieren wir Zod in unseren Rechnungsprozess:

1import { z } from 'zod';

2import { processInvoice } from './modern-invoice-handler.js';

3

4// 1. Den Türsteher definieren

5const cartItemSchema = z.object({

6 productId: z.string().min(1),

7 price: z.number().positive(),

8 quantity: z.number().int().min(1)

9});

10

11const invoiceRequestSchema = z.object({

12 userId: z.string().uuid(), // Muss eine echte UUID sein!

13 items: z.array(cartItemSchema).nonempty()

14});

15

16// 2. Den Türsteher vor die Route stellen (z.B. in Express.js)

17app.post('/api/checkout', async (req, res) => {

18 try {

19 // Hier schlägt Zod gnadenlos zu, wenn die Daten nicht passen

20 const validatedData = invoiceRequestSchema.parse(req.body);

21

22 // Ab hier wissen wir zu 100%, dass die Daten perfekt sind

23 const total = await processInvoice(validatedData.userId, validatedData.items);

24

25 res.json({ success: true, total });

26 } catch (error) {

27 // Ist der Fehler von Zod? Dann ist der Nutzer schuld (400 Bad Request)

28 if (error instanceof z.ZodError) {

29 return res.status(400).json({ errors: error.errors });

30 }

31 res.status(500).json({ error: "Interner Serverfehler" });

32 }

33});Erinnern Sie sich an das beklemmende Gefühl am Freitagnachmittag, das wir zu Beginn besprochen haben? Mit dieser Architektur ist es komplett verschwunden. Sie können fehlerhafte Daten, bösartige Skripte oder falsche Datentypen auf Ihr System abfeuern – Zod blockt sie ab, bevor sie Schaden anrichten. Ihre puren Funktionen arbeiten nur noch mit verifizierten, sauberen Daten.

Wir haben das Fundament unseres alten Projekts nun vollständig stabilisiert und nach außen hin gepanzert. Im nächsten Schritt betrachten wir, wie wir diese neuen Sicherheitsrichtlinien in einem großen Team aus Entwicklern kommunizieren und kulturell verankern, ohne dass ein Aufstand ausbricht.

Kulturwandel: Das Team auf die Reise mitnehmen

Wir haben nun eine beeindruckende technische Festung gebaut. Laufzeit-Validierung, strenge CI/CD-Pipelines und isolierte Datenbankzugriffe schützen unser System. Aber wissen Sie, woran die meisten großartigen Architektur-Initiativen in der Realität kläglich scheitern? Am menschlichen Faktor.

Sie können die sichersten und bestausgeleuchteten Straßen der Welt bauen. Wenn die Autofahrer die neuen Verkehrsschilder nicht verstehen oder sich von ihnen gegängelt fühlen, werden sie absichtlich querfeldein durch den Matsch fahren. Wenn wir Legacy Code absichern, greifen wir radikal in die täglichen Gewohnheiten unserer Kollegen ein. Wie verhindern wir also eine offene Rebellion im Entwickler-Team?

Ich erinnere mich lebhaft an mein erstes großes Refactoring-Projekt als frisch beförderter Senior-Entwickler. Ich war hochmotiviert, aktivierte über Nacht 50 extrem strenge ESLint-Regeln und blockierte rigoros alle Pull Requests in der Pipeline. Am nächsten Morgen war die Stimmung auf dem absoluten Nullpunkt. Die Feature-Entwicklung kam schlagartig zum Erliegen, und meine Kollegen waren maximal frustriert. Warum passierte das? Weil ich ihnen kalte Werkzeuge aufgezwungen hatte, ohne jemals das "Warum" dahinter zu erklären.

Architektur-Entscheidungen für die Ewigkeit festhalten (ADRs)

Wie machen wir es heute besser? Wir etablieren eine unerschütterliche Kultur der Transparenz. Jedes Mal, wenn wir ein neues Sicherheitskonzept einführen – wie etwa die strikte Trennung von Geschäftslogik und Datenbankzugriffen aus dem letzten Abschnitt –, dokumentieren wir dies in einem sogenannten Architecture Decision Record (ADR).

Ein ADR ist eine simple, leichtgewichtige Markdown-Datei, die direkt in unserem Git-Repository neben dem Quelltext lebt. Sie erklärt nicht mühsam, wie der Code funktioniert, sondern warum wir uns im Team für diesen speziellen Weg entschieden haben.

Lassen Sie uns einen Blick auf ein reales Beispiel werfen:

1# ADR 004: Kapselung von Datenbankzugriffen

2

3## Status

4Akzeptiert (05. April 2026)

5

6## Kontext

7Unser altes Skript für Rechnungen (legacy-invoice-processor.js) mischte komplexe Geschäftslogik direkt mit SQL-Queries. Dies machte schnelle Unit-Tests unmöglich und barg ein massives Risiko für SQL-Injections. Diesen Zustand müssen wir beheben, wenn wir unseren Legacy Code absichern wollen.

8

9## Entscheidung

10Wir führen das "Repository Pattern" ein. Direkte Aufrufe von `db.query` innerhalb der Geschäftslogik (z.B. in `modern-tax-calculator.js`) sind ab sofort strikt untersagt. Alle Datenbankzugriffe müssen über dedizierte Dateien im isolierten Ordner `/src/database/` erfolgen.

11

12## Konsequenzen

13Positiv: Reine Funktionen sind nun in Bruchteilen von Millisekunden testbar.

14Negativ: Entwickler müssen minimal mehr Boilerplate-Code schreiben, um verifizierte Daten an die Funktionen zu übergeben.Spüren Sie den Unterschied in der Kommunikation? Wenn ein neuer Kollege nun ins Team kommt und sich wundert, warum er den komfortablen Datenbank-Befehl nicht einfach direkt in seine Funktion tippen darf, findet er die logische, gut begründete Antwort sofort im Projekt. Das erzeugt intrinsische Akzeptanz anstelle von toxischer Frustration.

Die Spielregeln durch eigene ESLint-Plugins erzwingen

Doch Vertrauen und gute Dokumentation sind leider nur die halbe Miete. Unter massivem Zeitdruck oder kurz vor einem wichtigen Release fallen wir alle unweigerlich in bequeme, alte Muster zurück. "Nur dieses eine Mal greife ich schnell direkt auf die Datenbank zu, der Kunde wartet schon!" – das ist ein klassischer Satz, der den schleichenden Verfall einer jeden Architektur einläutet.

Um unsere neue ADR-Entscheidung unumstößlich zu machen, gießen wir unsere Team-Kultur in ausführbaren Code. Wir schreiben eine maßgeschneiderte, projektspezifische ESLint-Regel, die exakt unser neues Architekturmuster mit eiserner Faust verteidigt.

Das klingt zunächst nach Rocket Science, ist aber erstaunlich simpel. Hier ist ein pragmatisches Beispiel für ein lokales ESLint-Plugin, das den direkten Import unserer Datenbank-Bibliothek in unseren reinen Logik-Dateien hart blockiert:

1// eslint-local-rules/no-db-in-logic.js

2module.exports = {

3 meta: {

4 type: "problem",

5 docs: {

6 description: "Verhindert gefährliche direkte Datenbankzugriffe in der reinen Geschäftslogik",

7 },

8 messages: {

9 noDbInLogic: "Architektur-Verstoß! Bitte keine Datenbank in der Logikschicht importieren. Siehe ADR 004 für Details."

10 }

11 },

12 create(context) {

13 return {

14 ImportDeclaration(node) {

15 // 1. Prüfen, ob wir uns im geschützten Ordner für reine Geschäftslogik befinden

16 const filename = context.getFilename();

17 if (filename.includes('/src/logic/')) {

18

19 // 2. Prüfen, ob das verbotene Datenbank-Modul importiert wird

20 if (node.source.value === 'unser-datenbank-modul') {

21 context.report({

22 node,

23 messageId: "noDbInLogic"

24 });

25 }

26 }

27 }

28 };

29 }

30};Was passiert nun in der täglichen Praxis? Versucht ein Kollege in der Datei src/logic/tax-calculator.js ahnungslos den Befehl import db from 'unser-datenbank-modul' einzufügen, leuchtet sein Editor innerhalb von Millisekunden bedrohlich rot auf. Die Fehlermeldung verweist ihn freundlich, aber extrem bestimmt auf unser ADR 004.

Der Entwickler wird genau im richtigen Moment an die gemeinsamen Spielregeln erinnert, ohne dass ein Vorgesetzter eingreifen muss. Das ist Automatisierung auf allerhöchstem Niveau! Wir erziehen unser System dazu, sich proaktiv selbst zu verteidigen.

Wir haben nun physische Barrieren, automatisierte Workflows und das richtige Mindset im Team etabliert. In unserem finalen, alles entscheidenden Schritt betrachten wir den ultimativen Endgegner: Wie beweisen wir dem Management und den Stakeholdern eigentlich, dass sich dieser gewaltige zeitliche Aufwand auch finanziell lohnt?

Die Sprache des Geldes: Wie Sie das Management überzeugen

Wir haben nun alle technischen Register gezogen. Unser System ist gepanzert, die Pipeline läuft reibungslos, und das Team zieht an einem Strang. Doch eines Tages steht der Projektmanager in der Tür und stellt die gefürchtete Frage: "Warum haben wir in den letzten zwei Wochen keine neuen Features ausgeliefert? Die Konkurrenz schläft nicht!"

Das ist der Moment, an dem die meisten Entwickler frustriert aufgeben. Es ist unfassbar schwer, unsichtbare Arbeit zu verkaufen. Wenn wir Legacy Code absichern, bauen wir keine glitzernden neuen Buttons, die man anklicken kann. Wir betreiben fundamentale Risikominimierung.

Wie machen wir den Wert unserer Arbeit also sichtbar? Wir müssen aufhören, in technischen Begriffen wie "Pure Functions" oder "JSDoc" zu sprechen, wenn wir mit Stakeholdern verhandeln. Wir müssen die Sprache des Geldes sprechen: Zeit, Kosten und Risiko.

Stellen Sie sich vor, Sie besitzen eine Spedition. Wenn Sie nie das Motoröl Ihrer Lkws wechseln, sparen Sie kurzfristig Geld und Zeit. Die Fahrzeuge sind ununterbrochen auf der Straße. Doch irgendwann platzt der Motor mitten auf der Autobahn. Die Ladung verdirbt, der Lkw muss abgeschleppt werden, und der Kunde springt ab. Genau das ist technische Schuld in der Softwareentwicklung. Wir wechseln gerade das metaphorische Motoröl bei laufender Fahrt.

Messbare Erfolge: Den Abbau von Altlasten visualisieren

Behauptungen allein reichen im Management nicht aus; wir benötigen harte Fakten. Eine der elegantesten Methoden, um den Erfolg unseres Refactorings zu beweisen, ist das Messen der verbleibenden "Ausnahmen" in unserem Code. Erinnern Sie sich an den Anfang dieses Artikels? Wir haben tausende fehlerhafte Stellen mit // eslint-disable-next-line stummgeschaltet.

Jede einzelne dieser Zeilen ist eine tickende Zeitbombe. Wenn wir diese Bomben entschärfen, steigern wir die Code-Qualität. Warum schreiben wir nicht ein winziges Node.js-Skript, das exakt diesen Fortschritt misst und jeden Freitag automatisch in den Slack-Kanal des Managements postet?

Lassen Sie uns einen solchen "Tech-Debt-Tracker" bauen:

1// scripts/track-tech-debt.js

2import fs from 'fs';

3import path from 'path';

4import { execSync } from 'child_process';

5

6// Wir durchsuchen das gesamte 'src'-Verzeichnis

7const srcDir = path.join(process.cwd(), 'src');

8

9function countSuppressions(dir) {

10 let count = 0;

11 const files = fs.readdirSync(dir);

12

13 for (const file of files) {

14 const fullPath = path.join(dir, file);

15 if (fs.statSync(fullPath).isDirectory()) {

16 count += countSuppressions(fullPath);

17 } else if (fullPath.endsWith('.js') || fullPath.endsWith('.ts')) {

18 const content = fs.readFileSync(fullPath, 'utf-8');

19 // Zählt, wie oft der Suppress-Kommentar auftaucht

20 const matches = content.match(/eslint-disable-next-line/g);

21 if (matches) {

22 count += matches.length;

23 }

24 }

25 }

26 return count;

27}

28

29const currentSuppressions = countSuppressions(srcDir);

30const date = new Date().toISOString().split('T')[0];

31

32console.log(`📊 Tech-Debt Report vom ${date}:`);

33console.log(`Es existieren noch ${currentSuppressions} ignorierte Legacy-Warnungen.`);

34console.log(`Ziel für dieses Quartal: Unter 500 Warnungen fallen.`);

35

36// Bonus: Das Ergebnis direkt in eine Historien-Datei schreiben

37fs.appendFileSync('tech-debt-history.csv', `${date},${currentSuppressions}\n`);Was bewirkt dieses simple Skript? Es macht das Unsichtbare sichtbar. Wenn der Manager sieht, dass die Zahl der potenziellen Fehlerquellen von anfangs 14.500 auf mittlerweile 3.200 gesunken ist, versteht er sofort, wohin die Zeit geflossen ist.

Zusätzlich sinkt die "Time to Market" (die Zeit von der Idee bis zum fertigen Feature) drastisch, sobald der Code sauberer wird. Wo Entwickler früher drei Tage brauchten, um einen Bug in der Rabatt-Berechnung zu finden, liefert die automatisierte Pipeline den Fehlerort nun innerhalb von Sekunden. Das spart nicht nur Nerven, sondern bares Geld.

Fazit: Die Rettung ist ein Marathon, kein Sprint

Legacy Code absichern ist definitiv keine Aufgabe, die man mal eben an einem regnerischen Wochenende erledigt. Es ist ein tiefgreifender architektonischer und kultureller Wandel. Wir haben gesehen, wie wir mit Characterization Tests das Verhalten unserer alten Skripte gnadenlos einfrieren. Wir haben gelernt, wie JSDoc und eine smarte TypeScript-Konfiguration eine unsichtbare Brücke in die Moderne schlagen.

Wir haben eiserne Wachhunde in Form von CI/CD-Pipelines und Zod-Laufzeitvalidierungen installiert, um schadhaften Code abzuwehren. Und wir haben verstanden, dass die beste Architektur wertlos ist, wenn wir das Team und das Management nicht auf diese Reise mitnehmen.

Haben Sie keine Angst mehr vor dem Freitag-Nachmittag-Release. Mit den richtigen Strategien wird aus dem chaotischen, angsteinflößenden Legacy Code wieder ein verlässliches Fundament, auf dem Ihr Unternehmen die nächsten zehn Jahre sicher wachsen kann. Fangen Sie klein an. Isolieren Sie heute noch Ihre erste Datenbankabfrage. Der Weg aus dem Chaos beginnt mit einer einzigen, gut getesteten Funktion.

Teil der Serie

Veraltete Web-Projekte schrittweise retten

Veraltete Webseiten modernisieren: Dein Leitfaden für den sanften Umbau ohne Systemcrash Pillar

Sanfter Umbau: Der Astro Nginx Reverse Proxy als Brücke zum neuen Frontend

Headless CMS Contao WordPress: Das alte Backend behalten und das Design modernisieren

Bootstrap zu Tailwind CSS migrieren: Dein sicherer Weg aus dem Design-Chaos

Laravel Inertia Astro Setup: Wenn klassische PHP-Logik auf modernes JavaScript trifft

Mehr Sicherheit im Code: Alte Skripte schrittweise absichern

Legacy Datenbank optimieren: Alte Datenbestände für moderne Apps rüsten

Ladezeiten halbieren: So befreist du dein Frontend von unnötigem Ballast

Nichts kaputtmachen: Visuelle Regressionstests für sichere Web-Umbauten

Veröffentlichung ohne Risiko: Zero-Downtime Deployment meistern

Häufig gestellte Fragen (FAQ)

Stellen Sie sich vor, Sie finden eine antike, extrem zerbrechliche Vase. Bevor Sie anfangen, Risse zu kleben, fertigen Sie einen 3D-Scan an, um die exakte Originalform zu dokumentieren. Genau das tun Characterization Tests (Charakterisierungstests).

In altem JavaScript-Code existieren oft bizarre Bugs, die über die Jahre versehentlich zu "Features" wurden, auf die sich andere Systemteile verlassen. Anstatt sofort wild zu refactoren, frieren Sie mit einem Test-Framework wie Jest das aktuelle Verhalten ein.

// Beispiel für das Einfrieren eines absurden Ist-Zustands

test('sollte kurioserweise null zurückgeben, wenn der String leer ist', () => {

// Wir dokumentieren den Bug, anstatt ihn blind zu beheben!

expect(legacyPriceCalculator("")).toBeNull();

});Diese Tests bilden Ihr erstes, unverzichtbares Sicherheitsnetz. Wenn Sie später den Code aufräumen, warnt Sie dieses Netz sofort lautstark vor unbeabsichtigten Nebenwirkungen.

Auf gar keinen Fall! Ein sofortiger Großputz würde Ihr gesamtes Team wochenlang lahmlegen und ein massives Risiko für neue Fehler bergen. Das wäre wirtschaftlicher Selbstmord.

Die pragmatische Lösung lautet: Frieren Sie auch hier den Status quo ein. Werkzeuge wie suppress-eslint-errors fügen vollautomatisch über jedem einzelnen Regelverstoß einen // eslint-disable-next-line Kommentar ein. Dadurch wird das Bluten gestoppt. Ab diesem Tag schlägt Ihre CI/CD-Pipeline nur noch Alarm, wenn ein Entwickler einen neuen Fehler dieser Art in das Projekt einbaut. Die alten Sünden bauen Sie dann gemütlich und stückweise ab.

Ein kompletter Rewrite eines gewachsenen Systems gleicht dem Versuch, die Reifen eines Autos zu wechseln, während Sie mit Tempo 130 über die Autobahn rasen. Es endet fast immer im Desaster, weil die Weiterentwicklung neuer Features für Monate blockiert wird.

JSDoc bietet eine fantastische, sanfte Brückentechnologie. Sie reichern Ihre reinen JavaScript-Dateien mit Typen-Kommentaren an. Moderne Editoren lesen diese Kommentare und warnen Sie vor Fehlern, ganz ohne aufwendige Kompilierungsschritte.

Wenn Sie TypeScript einführen, tun Sie dies hybrid. Setzen Sie in Ihrer tsconfig.json den Wert "allowJs": true. So können Sie neue Features in sicheren .ts-Dateien schreiben, während der alte Code unangetastet als .js weiterläuft.

Vertrauen ist gut, gnadenlose Automatisierung ist besser. Wenn Abgabetermine drücken, ignorieren wir Menschen gerne blinkende Warnungen im Editor. Um Legacy Code dauerhaft abzusichern, müssen Sie die Sicherheitskontrolle an den "Grenzübergang" Ihres Projekts verlagern.

Nutzen Sie Husky, um sogenannte Pre-Commit-Hooks einzurichten. Sobald ein Kollege versucht, fehlerhaften Code via git commit in das Repository zu schieben, blockiert Husky den Vorgang physisch.

Zusätzlich etablieren Sie eine CI/CD-Pipeline (z.B. mit GitHub Actions). Diese fährt auf dem Server eine neutrale Testumgebung hoch und führt den Linter sowie alle Tests aus. Ein Pull Request darf erst zusammengeführt werden (Merge), wenn die Pipeline grünes Licht gibt.

Diese Analogie stammt aus der Botanik. Eine Würgefeige wächst im Dschungel von oben an einem alten, sterbenden Baumstamm herab. Sie umschlingt ihn, nutzt ihn als Gerüst und ersetzt ihn über die Jahre komplett, bis der alte Baum lautlos verschwindet.

In der Softwarearchitektur bedeutet das: Schreiben Sie gigantische, monolithische Skripte nicht komplett neu. Extrahieren Sie stattdessen winzige, wertvolle Teile (wie eine Steuerberechnung) in kleine, isolierte und perfekt getestete Funktionen (Pure Functions). Klemmen Sie diese frischen "Feigenranken" dann in den alten Code ein. So tauschen Sie das System von innen heraus aus, ohne dass es jemals stehen bleibt.

Das ist einer der gefährlichsten Irrtümer in der Webentwicklung! TypeScript beschützt Sie nur während Sie den Code tippen. Auf dem Live-Server existiert TypeScript nicht mehr. Wenn eine externe Schnittstelle plötzlich ein String-Emoji anstelle einer Zahl sendet, stürzt Ihr ungeschütztes System ab.

Hier benötigen Sie einen unbestechlichen Türsteher für die Laufzeit. Die Bibliothek Zod ist hierfür der absolute Branchenstandard.

1import { z } from 'zod';

2

3// Der Zod-Türsteher definiert das knallharte Gesetz

4const userSchema = z.object({

5 age: z.number().min(18)

6});

7

8// Eingehende Daten werden gnadenlos geprüft, bevor sie die Geschäftslogik berühren

9const safeData = userSchema.parse(incomingApiRequest);Zod fängt fehlerhafte oder bösartige Payloads ab, lange bevor sie Ihre wertvollen, neugeschriebenen Funktionen erreichen.

Verzichten Sie in Meetings mit Stakeholdern auf technische Fachbegriffe wie "Dependency Injection" oder "Unit Tests". Sprechen Sie stattdessen konsequent die Sprache des Geldes: Zeit, Kosten und Risikominimierung.

Nutzen Sie die Metapher des Motorölwechsels bei einer Spedition. Wer das Öl bei seinen Lkws nie wechselt, spart kurzfristig Geld, riskiert aber einen katastrophalen Motorschaden auf der Autobahn (Systemausfall).

Machen Sie Ihre unsichtbare Arbeit messbar. Schreiben Sie ein kleines Skript, das die verbliebenen // eslint-disable-Kommentare in Ihrem Projekt zählt. Senden Sie jeden Freitag einen automatisierten Bericht: "Wir haben diese Woche 450 potenzielle Fehlerquellen und Sicherheitsrisiken aus dem System entfernt. Die Zeit für das Finden von Bugs hat sich um 20% reduziert." Wenn das Management den sinkenden Graphen der technischen Schulden sieht, wird es den finanziellen Wert Ihrer Arbeit sofort begreifen.

Ausblick: Die Festung steht – jetzt sanieren wir den Keller

Wir haben es gemeinsam geschafft. Unser ehemals verstaubter Legacy Code ist von einem fragilen Kartenhaus zu einer robusten, abwehrbereiten Festung herangewachsen. Die CI/CD-Pipeline wacht mit eiserner Hand, Zod filtert toxische Daten bereits an der Tür heraus, und TypeScript gibt uns beim Schreiben neuer Features die dringend benötigte Orientierung. Sie können abends endlich wieder beruhigt den Laptop zuklappen, ohne die ständige Angst vor nächtlichen Server-Abstürzen im Nacken zu spüren.

Doch halt! Warum ruckelt die frisch modernisierte App bei plötzlichen Spitzenlasten trotzdem noch? Warum dreht sich der Ladekreis unerbittlich weiter? Die Antwort liegt meist tief im Verborgenen. Was nützt uns der schnellste, sauberste API-Endpunkt, wenn er auf ein archaisches Daten-Nadelöhr warten muss?

Erinnern Sie sich an Ihr letztes großes Projekt, bei dem ein einziger fehlender SQL-Index die gesamte Checkout-Seite für quälende fünf Sekunden einfrieren ließ? Der Nutzer springt ab, der Umsatz geht verloren – und das alles nur, weil die Datenbankstruktur nicht mitgewachsen ist. Genau dieses frustrierende Szenario packen wir als Nächstes an.

Im kommenden, sechsten Teil unserer Cluster-Serie verlassen wir die Anwendungsschicht und steigen hinab in den Maschinenraum: unsere Datenbanken. Alte relationale Datenbanken (SQL) gleichen in Legacy-Projekten oft einem vollgestopften, dunklen Dachboden. Über Jahre hinweg wurden Spalten hastig hinzugefügt, obsolete Datensätze aus Angst nie gelöscht und Tabellen bis zur völligen Unkenntlichkeit miteinander verknüpft.

Wir zeigen Ihnen anhand echter, greifbarer Projektbeispiele mit Node.js, Laravel und SQL, wie Sie diesen historischen Datenschrott systematisch ausmisten. Wir schreiben keinen theoretischen Bla-Bla-Code, sondern echte Migrations-Skripte. Sie lernen hautnah, wie Sie extrem langsame Queries entlarven, Datenbank-Migrationen bei laufendem Betrieb (Zero Downtime) durchführen und Ihre Tabellen so strukturieren, dass moderne Anwendungen wieder blitzschnell darauf zugreifen können.

Sind Sie bereit, den ultimativen Flaschenhals in Ihrem System endgültig zu zerschlagen? Dann begleiten Sie uns direkt in den nächsten Artikel:

Dietrich Bojko

Senior Webentwickler

Webinteger arbeitet seit vielen Jahren produktiv mit

Linux-basierten Entwicklungsumgebungen unter Windows.

Der Fokus liegt auf

performanten Setups mit WSL 2, Docker, PHP, Node.js und modernen

Build-Tools in realen Projekten –

nicht auf theoretischen Beispielkonfigurationen.

Die Artikel dieser Serie entstehen direkt aus dem täglichen Einsatz in Kunden- und Eigenprojekten und dokumentieren bewusst auch typische Fehler, Engpässe und bewährte Workarounds.